هوش مصنوعی مسئول: همکاری تحقیقاتی پشت ابزارهای منبع باز جدید ارائه شده توسط مایکروسافت

به سایت آموزشی میتوانید خوش آمدید، درضمن اگر برای کسب و کار به جذب مشتری نیاز دارید پیشنهاد میکنیم روی سایت تبلیغات کلیک کنید تا بزرگترین سایت تبلیغات ایران بشوید.

هوش مصنوعی مسئول: همکاری تحقیقاتی پشت ابزارهای منبع باز جدید ارائه شده توسط مایکروسافت

از آنجایی که پیشرفتهای محاسباتی و هوش مصنوعی طی دههها فرصتهای باورنکردنی را برای مردم و جامعه فراهم میکنند، آنها همچنین سؤالاتی را در مورد توسعه و استقرار مسئولانه ایجاد میکنند. به عنوان مثال، مدلهای یادگیری ماشینی که سیستمهای هوش مصنوعی را تقویت میکنند ممکن است برای همه یا هر شرایطی یکسان عمل نکنند و به طور بالقوه منجر به آسیبهای مربوط به ایمنی، قابلیت اطمینان و انصاف شوند. معیارهای منفرد که اغلب برای نشان دادن قابلیت مدل استفاده میشوند، مانند دقت کلی، برای نشان دادن اینکه در چه شرایطی یا برای چه کسانی احتمال شکست بیشتر است، کار چندانی انجام نمیدهند. در همین حال، رویکردهای رایج برای رسیدگی به خرابیها، مانند افزودن دادههای بیشتر و محاسبه یا افزایش اندازه مدل، به ریشه مشکل نمیرسند. بعلاوه، این رویکردهای آزمایشی و خطای فراگیر می توانند منابع فشرده و از نظر مالی پرهزینه باشند.

از آنجایی که پیشرفتهای محاسباتی و هوش مصنوعی طی دههها فرصتهای باورنکردنی را برای مردم و جامعه فراهم میکنند، آنها همچنین سؤالاتی را در مورد توسعه و استقرار مسئولانه ایجاد میکنند. به عنوان مثال، مدلهای یادگیری ماشینی که سیستمهای هوش مصنوعی را تقویت میکنند ممکن است برای همه یا هر شرایطی یکسان عمل نکنند و به طور بالقوه منجر به آسیبهای مربوط به ایمنی، قابلیت اطمینان و انصاف شوند. معیارهای منفرد که اغلب برای نشان دادن قابلیت مدل استفاده میشوند، مانند دقت کلی، برای نشان دادن اینکه در چه شرایطی یا برای چه کسانی احتمال شکست بیشتر است، کار چندانی انجام نمیدهند. در همین حال، رویکردهای رایج برای رسیدگی به خرابیها، مانند افزودن دادههای بیشتر و محاسبه یا افزایش اندازه مدل، به ریشه مشکل نمیرسند. بعلاوه، این رویکردهای آزمایشی و خطای فراگیر می توانند منابع فشرده و از نظر مالی پرهزینه باشند.

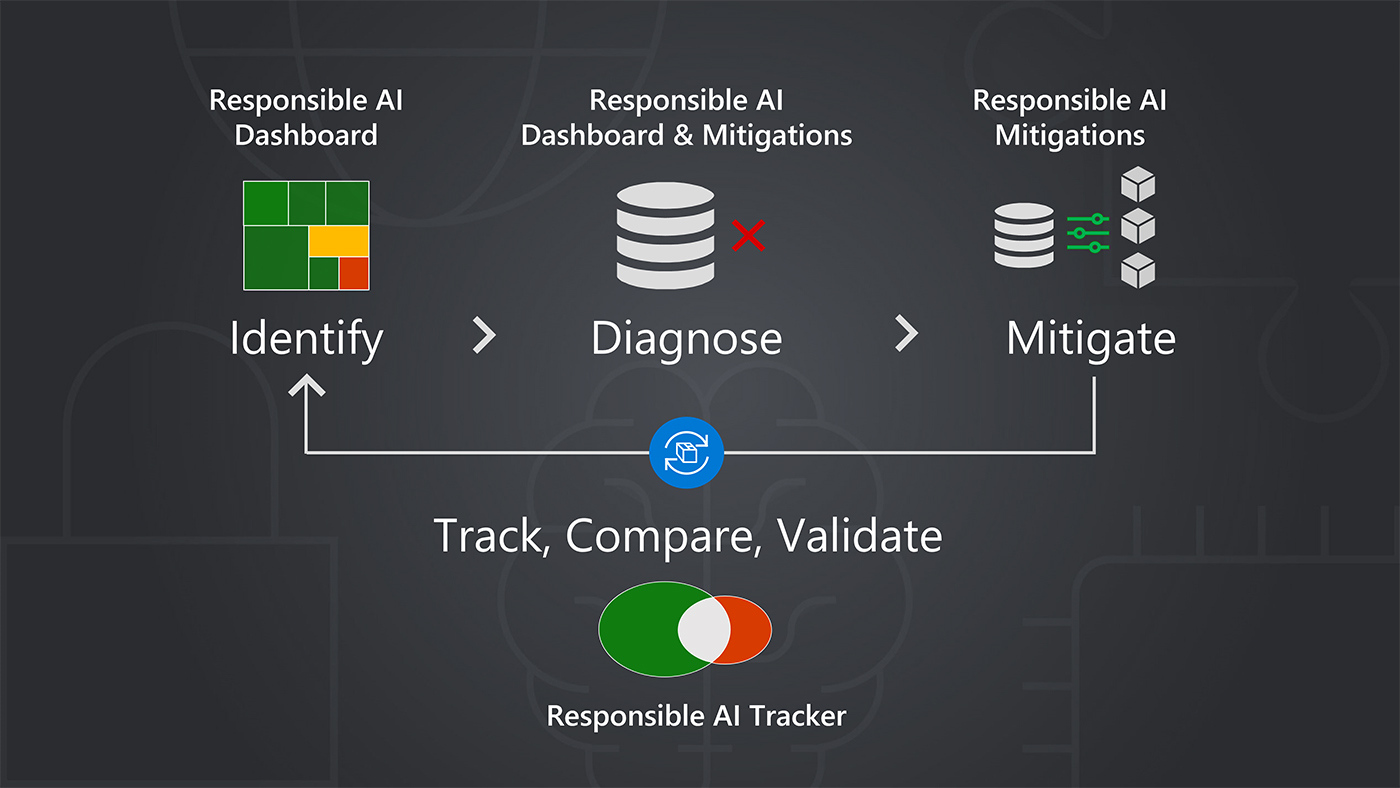

از طریق جعبه ابزار هوش مصنوعی مسئول خود، مجموعه ای از ابزارها و عملکردهایی که برای کمک به پزشکان برای به حداکثر رساندن مزایای سیستمهای هوش مصنوعی و در عین حال کاهش آسیبها و سایر تلاشها برای هوش مصنوعی مسئولانه طراحی شدهاند، مایکروسافت یک جایگزین ارائه میدهد: رویکردی اصولی برای توسعه هوش مصنوعی با محوریت بهبود مدل هدفمند. هدف بهبود مدلها از طریق روشهای هدفیابی، شناسایی راهحلهای متناسب با علل شکستهای خاص است. این بخش مهمی از چرخه عمر بهبود مدل است که نه تنها شامل شناسایی، تشخیص و کاهش خرابیها میشود، بلکه شامل ردیابی، مقایسه و اعتبارسنجی گزینههای کاهش میشود. این رویکرد از شاغلین در رسیدگی بهتر به شکستها بدون معرفی موارد جدید یا فرسایش سایر جنبههای عملکرد مدل پشتیبانی میکند.

و عملی تشویق کنیم.” com/en-us/research/people/benushi/about/” target=”_blank” rel=”noreferrer noopener”>بسمیرا نوشی، محقق اصلی مایکروسافت که درگیر توسعه ابزارهایی برای پشتیبانی از هوش مصنوعی مسئول است. او یکی از اعضای تیم تحقیقاتی پشت جدیدترین افزودههای جعبه ابزار است: کتابخانه مسئول کاهش هوش مصنوعی، که به پزشکان امکان میدهد راحتتر با تکنیکهای مختلف برای رسیدگی به خرابیها و ردیاب هوش مصنوعی مسئول آزمایش کنید.، که از تجسم ها برای نشان دادن اثربخشی تکنیک های مختلف برای تصمیم گیری آگاهانه تر استفاده می کند.

بهبود مدل هدفمند: از شناسایی تا اعتبارسنجی

ابزارهای موجود در جعبه ابزار مسئولیتپذیر هوش مصنوعی، در منبع باز و از طریق پلتفرم یادگیری ماشینی Azure ارائه شده توسط مایکروسافت، با در نظر گرفتن هر مرحله از چرخه عمر بهبود مدل طراحی شده اند و از طریق تجزیه و تحلیل خطا، ارزیابی عادلانه، کاوش داده ها و تفسیرپذیری به بهبود مدل هدفمند اطلاع رسانی می کنند.

برای مثال، کتابخانه کاهشدهندههای جدید با ارائه ابزاری برای مدیریت خرابیهایی که در پیشپردازش دادهها رخ میدهد، مانند مواردی که ناشی از کمبود داده یا دادههای با کیفیت پایین برای یک زیرمجموعه خاص است، کاهش را تقویت میکند. برای ردیابی، مقایسه و اعتبارسنجی، ردیاب جدید مدل، کد، تجسمها و سایر اجزای توسعه را برای مستندسازی آسان تلاشهای کاهش با هم ترکیب میکند. ویژگی اصلی ردیاب ارزیابی و مقایسه مدل تفکیکشده، که عملکرد مدل را بر اساس زیرمجموعه دادهها تجزیه میکند تا تصویر واضحتری از اثرات کاهشدهنده بر زیرمجموعه مورد نظر و همچنین سایر زیرمجموعهها ارائه دهد، و به کشف افت عملکرد پنهان قبل از استقرار مدلها کمک میکند. توسط افراد و سازمان ها استفاده می شود. علاوه بر این، ردیاب به پزشکان اجازه میدهد تا عملکرد زیرمجموعههای داده را در تکرارات یک مدل بررسی کنند تا به پزشکان کمک کند تا مناسبترین مدل را برای استقرار تعیین کنند.

«دانشمندان داده میتوانند بسیاری از قابلیتهایی را که ما ارائه میدهیم با این ابزارها ایجاد کنند. آنها می توانند زیرساخت های خود را بسازند. اما انجام این کار برای هر پروژه نیازمند تلاش و زمان زیادی است. مزیت این ابزارها مقیاس است. در اینجا، آنها میتوانند با ابزارهایی که در سناریوهای متعدد کاربرد دارند، کار خود را تسریع بخشند، و آنها را آزاد کنند تا روی کار ساخت مدلهای قابل اعتمادتر و قابل اعتمادتر تمرکز کنند.»

بسمیرا نوشی، محقق اصلی مایکروسافت

ساخت ابزارهایی برای هوش مصنوعی مسئول که شهودی، مؤثر و ارزشمند هستند، میتواند به پزشکان کمک کند تا هنگام توسعه یک مدل جدید، آسیبهای احتمالی و کاهش آنها را از ابتدا در نظر بگیرند. نوشی میگوید، نتیجه میتواند اطمینان بیشتری باشد که کاری که انجام میدهند از هوش مصنوعی ایمنتر، منصفانهتر و قابل اعتمادتر پشتیبانی میکند، زیرا به این ترتیب طراحی شده است. مزایای استفاده از این ابزارها می تواند بسیار گسترده باشد – از کمک به سیستم های هوش مصنوعی که با داشتن دقت قابل مقایسه در گروه های جمعیتی به ارزیابی منصفانه کاندیداها برای وام ها می پردازند تا آشکارسازهای علائم راهنمایی و رانندگی در خودروهای خودران که می توانند در شرایطی مانند آفتاب، برف عملکرد بهتری داشته باشند. ، و باران.

ایجاد ابزارهایی که میتوانند تأثیری داشته باشند که محققان مانند Nushi تصور میکنند، اغلب با یک سؤال تحقیقاتی شروع میشود و شامل تبدیل کار بهدستآمده به چیزی است که افراد و تیمها میتوانند به آسانی و با اطمینان در جریان کاری خود بگنجانند.

نوشی میگوید: «پرش از کد یک مقاله تحقیقاتی در GitHub به چیزی که قابل استفاده است، مستلزم فرآیند بسیار بیشتری از نظر درک تعاملی است که دانشمند داده به آن نیاز دارد و چه چیزی آنها را سازندهتر میکند.» «در تحقیقات، ما به ایدههای زیادی میرسیم. برخی از آنها بیش از حد فانتزی هستند، به طوری که نمی توان از آنها در دنیای واقعی استفاده کرد، زیرا نمی توانند عملیاتی شوند.”

تیمهای تحقیقاتی چند رشتهای متشکل از پژوهشگران تجربه کاربری، طراحان، و مهندسین یادگیری ماشین و مهندسین مقدماتی، به پایهگذاری این فرآیند کمک کردهاند، همانطور که مشارکت افرادی که در همه چیزهای مسئول هوش مصنوعی تخصص دارند، کمک کردهاند. Microsoft Research از نزدیک با تیم انکوباسیون Aether، نهاد مشاوره برای رهبری مایکروسافت در زمینه اخلاق و اثرات هوش مصنوعی، برای ایجاد ابزارهایی بر اساس تحقیقات. نوشی میگوید، مشارکت با تیمهای محصول که ماموریت آنها عملیاتی کردن هوش مصنوعی مسئولانه است، به همان اندازه مهم بوده است. برای تحقیقات مایکروسافت، اغلب Azure است یادگیری ماشین، پلتفرم مایکروسافت برای توسعه مدل ML سرتاسر. از طریق این رابطه، یادگیری ماشینی Azure میتواند آنچه را مدیر PM اصلی مایکروسافت ارائه کند. مهرنوش سامکی به «سیگنالهای» مشتری اشاره میکند، که اساساً جریان قابل اعتمادی از خواستهها و نیازهای پزشکان به طور مستقیم از پزشکان حاضر در زمین است. و، یادگیری ماشینی Azure به همان اندازه هیجانزده است که از آنچه Microsoft Research و Aether ارائه میکنند استفاده کند: علم پیشرفته. این رابطه مثمر ثمر بوده است.

از آنجایی که پلتفرم فعلی یادگیری ماشینی Azure پنج سال پیش شروع به کار کرد، مشخص بود که ابزارسازی برای هوش مصنوعی مسئول ضروری است. مشتریان علاوه بر همسویی با چشم انداز مایکروسافت برای توسعه هوش مصنوعی، به دنبال چنین منابعی بودند. سامکی، که رهبری تیم یادگیری ماشینی Azure مسئول ابزارسازی برای هوش مصنوعی مسئول را بر عهده دارد، با درخواستهایی برای ویژگیهای توضیحپذیری و تفسیرپذیری، روشهای معتبر اعتبارسنجی مدل و ابزارهای ارزیابی عادلانه، به تیم یادگیری ماشین Azure نزدیک شدند. Microsoft Research، Aether و Learning Machine Azure برای ادغام ابزارهایی برای هوش مصنوعی مسئول در این پلتفرم با هم همکاری کردند، از جمله InterpretML برای درک رفتار مدل، تجزیه و تحلیل خطا برای شناسایی زیرمجموعه های داده ای که احتمال خرابی آنها بیشتر است. و Fairlearn برای ارزیابی و کاهش مسائل مربوط به عدالت. InterpretML و Fairlearn پروژههای مستقل مبتنی بر جامعه هستند که چندین عملکرد جعبه ابزار مسئولیتپذیر هوش مصنوعی را تقویت میکنند.

پیش از این، Azure Machine Learning با سیگنال دیگری به تحقیقات مایکروسافت نزدیک شد: مشتریان می خواستند از ابزارها با هم و در یک رابط استفاده کنند. تیم تحقیقاتی با رویکردی پاسخ داد که قابلیت همکاری را امکان پذیر می کرد و به ابزارها اجازه می داد داده ها و بینش ها را مبادله کنند و تجربه یکپارچه اشکال زدایی ML را تسهیل کند. در طول دو تا سه ماه، تیمها هر هفته برای ایدهپردازی و طراحی «یک شیشه واحد» ملاقات میکردند که تمرینکنندگان میتوانستند به طور جمعی از ابزارها استفاده کنند. همانطور که Azure Machine Learning پروژه را توسعه داد، تحقیقات مایکروسافت از ارائه تخصص طراحی گرفته تا مشارکت در چگونگی داستان و قابلیتهای چیزی که تبدیل به داشبورد مسئول هوش مصنوعی به مشتریان اطلاع داده خواهد شد.

بعد از انتشار، تیمها وارد چالش باز بعدی شدند: تمرینکنندگان را قادر میسازند تا شکستها را بهتر کاهش دهند. وارد کتابخانه Responsible AI Mitigations و Responsible AI Tracker شوید که توسط Microsoft Research با همکاری Aether توسعه یافته اند. مایکروسافت ریسرچ به خوبی مجهز به منابع و تخصص برای کشف موثرترین تجسمها برای انجام مقایسه مدلهای تفکیکشده (کار قبلی بسیار کمی روی آن وجود داشت) و پیمایش انتزاعهای مناسب برای پیچیدگیهای اعمال کاهشهای مختلف در زیر مجموعههای مختلف بود. داده ها با یک رابط انعطاف پذیر و آسان برای استفاده. در طول این فرآیند، تیم Azure بینشی در مورد نحوه قرارگیری ابزارهای جدید در زیرساخت های موجود ارائه کرد.

سامکی میگوید با تیم Azure که نیازهای تمرینکننده و پلتفرم را به روی میز میآورد و تحقیقاتی که جدیدترین ارزیابیهای مدل، آزمایشهای مسئولانه و موارد مشابه را ارائه میدهد، مناسب است.

در حالی که در دسترس قرار دادن این ابزارها از طریق یادگیری ماشینی Azure از مشتریان پشتیبانی میکند تا محصولات و خدمات خود را مسئولانه به بازار عرضه کنند، ساخت این ابزارها متنباز برای ایجاد چشماندازی حتی بزرگتر از هوش مصنوعی توسعهیافته مهم است. هنگامی که انتشار آماده شد، این ابزارها برای هوش مصنوعی مسئول تبدیل به منبع باز می شوند و سپس در پلت فرم یادگیری ماشینی Azure ادغام می شوند. نوشی و سامکی میگویند:

دلایل استفاده از رویکرد اول منبع باز متعدد است

- ابزارهای رایگان در دسترس برای هوش مصنوعی مسئول یک منبع آموزشی برای یادگیری و آموزش تمرین هوش مصنوعی مسئول هستند؛

- مشارکتکنندگان بیشتر، چه داخلی و چه خارجی، کیفیت، طول عمر و هیجان را به کار و موضوع اضافه میکنند. و

- توانایی ادغام آنها در هر پلتفرم یا زیرساختی استفاده گسترده تر را تشویق می کند.

این تصمیم همچنین نشان دهنده یکی از اصول هوش مصنوعی مایکروسافت در عمل—شفافیت.

سامکی میگوید: «در فضای هوش مصنوعی مسئولانه، باز بودن تا حد امکان راهگشاست و دلایل متعددی برای آن وجود دارد. دلیل اصلی ایجاد اعتماد با کاربران و مصرف کنندگان این ابزارها است. به نظر من، هیچ کس به تکنیک ارزیابی یادگیری ماشین یا یک الگوریتم کاهش ناعادلانه که منبع نامشخص و نزدیک است اعتماد نمی کند. همچنین این رشته بسیار جدید است. نوآوری در فضای باز باعث پرورش همکاری های بهتر در این زمینه می شود.»

مهرنوش سامکی، مدیر ارشد PM مایکروسافت

نگاه به جلو

قابلیتهای هوش مصنوعی فقط در حال پیشرفت هستند. جامعه تحقیقاتی بزرگتر، شاغلان، صنعت فناوری، دولت و سایر موسسات به روشهای مختلف تلاش میکنند تا این پیشرفتها را به سمتی هدایت کنند که در آن هوش مصنوعی به ارزش کمک کند و آسیبهای احتمالی آن به حداقل برسد. برای حمایت از این تلاشها، شیوههای هوش مصنوعی مسئول باید با پیشرفتهای هوش مصنوعی به تکامل خود ادامه دهند.

برای محققان مایکروسافت مانند Nushi و مدیران محصول مانند Sameki، این به معنای تقویت همکاریهای بین شرکتی و چند رشتهای در توسعه مداوم ابزارهایی است که بهبود مدل هدفمند را با هدایت فرآیند گام به گام شناسایی، تشخیص، کاهش، تشویق میکند. و مقایسه و اعتبار – هر کجا که این پیشرفت ها منجر شود.

“همانطور که در این زمینه بهتر می شویم، امیدوارم به سمت یک فرآیند سیستماتیک تر حرکت کنیم تا بفهمیم چه داده هایی واقعاً مفید هستند، حتی برای مدل های بزرگ. چه چیزی مضر است که واقعاً نباید در آنها گنجانده شود. نوشی میگوید و اگر آنها را وارد کنید، چه دادههایی وجود دارد که مسائل اخلاقی زیادی دارد. «ساختن مسئولانه هوش مصنوعی مقطعی است و به دیدگاه ها و مشارکت تیم های داخلی و متخصصان خارجی نیاز دارد. مجموعه رو به رشد ابزارهای ما نشان میدهد که همکاری مؤثر این پتانسیل را دارد که بر نحوه ایجاد نسل جدید سیستمهای هوش مصنوعی تأثیر بگذارد – برای بهتر شدن.»

پیشنهاد میکنیم از دیگر نوشته ها دیدن کنید.